Revolusi Senyap di Balik Layar: Benarkah Agentic Swarm Mampu Mentransformasi Produksi Aplikasi Mobile dan Web, ataukah Ia Justru Bom Waktu bagi Pipeline CI/CD?

I. Sekilas tentang Pembahasan Topik

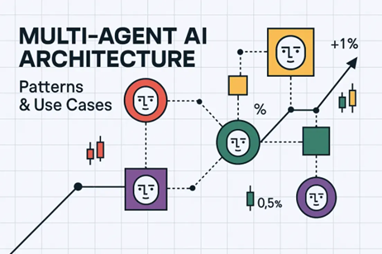

Arsitektur sistem multi-agent AI yang mengilustrasikan pola kolaborasi antar agen spesialis [Sumber: Medium/AI Plain English].

Arsitektur sistem multi-agent AI yang mengilustrasikan pola kolaborasi antar agen spesialis [Sumber: Medium/AI Plain English].

Dalam beberapa tahun terakhir, industri teknologi telah menyaksikan lonjakan dramatis dalam penggunaan kecerdasan buatan (AI) untuk mengotomatisasi berbagai aspek pengembangan perangkat lunak. Salah satu pendekatan yang paling menjanjikan sekaligus kontroversial adalah konsep agentic swarm—sekumpulan agen AI otonom yang bekerja secara kolaboratif untuk menyelesaikan tugas-tugas pengembangan yang kompleks. Berbeda dengan asisten coding konvensional yang beroperasi sebagai entitas tunggal, agentic swarm meniru dinamika tim manusia dengan membagi tanggung jawab di antara agen-agen spesialis: ada yang fokus pada arsitektur, ada yang menangani pengujian, dan ada pula yang mengurus dokumentasi [1].

Namun, di balik gembar-gembor kemajuan ini, muncul pertanyaan fundamental yang menggelisahkan para praktisi DevOps dan insinyur perangkat lunak senior: apakah paradigma ini benar-benar siap untuk diterapkan dalam lingkungan produksi aplikasi mobile dan web yang menuntut reliabilitas tinggi? Atau justru, dengan memberikan otonomi lebih besar pada mesin, kita secara tidak sengaja menciptakan kerentanan baru dalam pipeline Continuous Integration dan Continuous Deployment (CI/CD) yang menjadi tulang punggung pengembangan modern? Artikel ini akan mengupas tuntas dilema tersebut, menelisik bukti empiris dari penelitian terkini, serta menawarkan perspektif kritis tentang kapan dan bagaimana agentic swarm dapat diintegrasikan tanpa mengorbankan stabilitas sistem.

II. Konflik dan Masalah yang Di-highlight

Ketika Otonomi Bertabrakan dengan Prediktabilitas

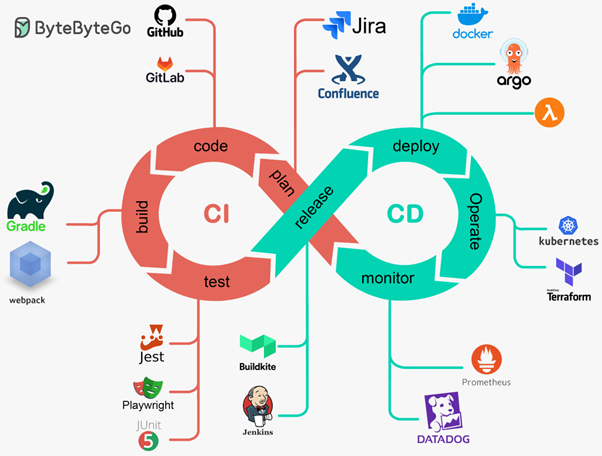

Masalah utama yang dihadapi oleh agentic swarm dalam konteks CI/CD adalah ketegangan inheren antara otonomi agen dan kebutuhan akan prediktabilitas dalam pipeline deployment. Sistem CI/CD modern dirancang berdasarkan prinsip deterministik: setiap input yang sama harus menghasilkan output yang identik, memungkinkan tim untuk menelusuri, mereproduksi, dan memperbaiki kesalahan dengan presisi [4]. Namun, agen AI—terutama yang didasarkan pada Large Language Models (LLMs)—secara inheren bersifat probabilistik. Mereka dapat menghasilkan solusi berbeda untuk masalah yang identik tergantung pada konteks percakapan, suhu model, atau bahkan urutan token dalam prompt [1].

Ketidakpastian ini bukan sekadar masalah teknis; ia memiliki implikasi finansial dan operasional yang serius. Sebuah studi yang diterbitkan dalam AI Agentic Programming: A Survey menunjukkan bahwa 76% pengembang yang menggunakan alat AI coding mengalami frekuensi halusinasi tinggi dengan kepercayaan rendah terhadap kode yang dihasilkan, di mana satu dari lima saran AI mengandung kesalahan [1]. Dalam konteks CI/CD, di mana satu kesalahan dapat memicu cascading failure di seluruh infrastruktur, statistik ini mengabarkan bahaya nyata. Bayangkan skenario di mana agen deployment otonom salah menginterpretasikan dependensi library dan secara otomatis mendorong versi yang tidak kompatibel ke production—kerusakan dapat terjadi dalam hitungan detik, jauh sebelum manusia sempat bereaksi.

Gambar 2: Ilustrasi kompleksitas pipeline CI/CD modern yang rentan terhadap gangguan dari sistem otonom [Sumber: ByteByteGo Newsletter].

Gambar 2: Ilustrasi kompleksitas pipeline CI/CD modern yang rentan terhadap gangguan dari sistem otonom [Sumber: ByteByteGo Newsletter].

Kerentanan Keamanan yang Tersembunyi

Aspek yang lebih mengkhawatirkan adalah permukaan serangan baru yang diperkenalkan oleh agen otonom. Penelitian dari Checkmarx mengidentifikasi beberapa vektor ancaman kritis yang tidak tercakup oleh strategi Application Security (AppSec) tradisional, termasuk prompt injection—di mana agen dimanipulasi oleh instruksi berbahaya yang disematkan dalam input—dan supply chain drift, ketika agen menarik paket atau dependensi yang tidak terverifikasi dari registry publik [8]. Dalam lingkungan swarm, kerentanan ini diperparah oleh efek multiplikasi: jika satu agen tersusupi, ia dapat menyebarkan kode berbahaya ke agen lain melalui mekanisme koordinasi internal.

Selain itu, terdapat fenomena yang disebut denial-of-wallet, di mana tugas agen yang tidak terbatas ruang lingkupnya dapat melampaui kendali dan menimbulkan biaya komputasi yang signifikan [8]. Dalam sistem swarm yang terdiri dari puluhan agen berjalan paralel, risiko ini menjadi eksponensial. Sebuah laporan industri mencatat bahwa organisasi kehilangan rata-rata 4,2 juta dolar Amerika Serikat setiap tahunnya karena keterlambatan rilis yang disebabkan oleh bottleneck pengujian, namun solusi yang tidak terkontrol dapat mengubah bottleneck menjadi bencana finansial [4].

Fragmentasi Konteks dan Kompleksitas Debugging

Tantangan ketiga berkaitan dengan apa yang para peneliti sebut sebagai context blindness—kecenderungan agen AI untuk kehilangan informasi relevan meskipun pengembang secara manual telah menyeleksi konteks yang diperlukan [7]. Dalam arsitektur swarm, di mana setiap agen beroperasi dengan subset informasi yang terbatas dan berkomunikasi melalui protokol antar-agen, fragmentasi konteks menjadi masalah yang magnified. Sebuah studi evaluatif dari Universitas Lund menemukan bahwa swarm agen LLM menghasilkan respons yang dinilai akurat hanya 3,25 dari 5 skala Likert, dengan frekuensi minimal satu respons tidak akurat per sesi interaksi [10].

Dampaknya pada CI/CD adalah mengerikan: ketika pipeline gagal, tim DevOps harus mampu melakukan root cause analysis dengan cepat. Namun, jika kegagalan disebabkan oleh keputusan kolektif yang diambil oleh puluhan agen yang saling berinteraksi, proses debugging menjadi semacam detektif forensik digital yang memakan waktu. Seperti yang dicatat oleh peneliti di Google, “A long-running agent is a bug, not a feature”—karena runtime yang panjang menandakan agen kemungkinan telah mencapai batas konteksnya, memadatkan memorinya, dan secara perlahan melupakan maksud asli dari perintah yang diberikan [9].

III. Solusi dan Narasi Alternatif

Pendekatan Hibrida: Menjaga Manusia dalam Lingkaran Pengawasan

Salah satu solusi yang paling banyak diadvokasi oleh peneliti adalah model hibrida yang menggabungkan efisiensi agen AI dengan pengawasan manusia yang terstruktur. Alih-alih memberikan otonomi penuh pada swarm, organisasi dapat menerapkan apa yang disebut “autonomy slider”—spektrum yang memungkinkan tim untuk secara bertahap meningkatkan keterlibatan AI seiring dengan membangun kepercayaan dan menetapkan quality gates yang jelas [7]. Dalam konteks CI/CD, ini berarti agen dapat diizinkan untuk menangani tugas-tugas berisiko rendah seperti pemformatan kode atau pembuatan unit test, sementara keputusan deployment ke production tetap memerlukan persetujuan manusia.

Studi dari Google Cloud tentang implementasi multi-agent systems merekomendasikan pendekatan bertahap: memulai dengan 2-3 agen yang menyelesaikan satu masalah spesifik, membuktikan nilai tambahnya sebelum meluas ke alur kerja yang lebih kompleks [6]. Strategi ini mengurangi risiko cascading failure dan memungkinkan tim untuk mengidentifikasi serta mengatasi masalah koordinasi pada skala yang lebih kecil. Lebih penting lagi, organisasi yang berhasil mencapai return on investment (ROI) umumnya memulai dengan kasus penggunaan berisiko rendah seperti pemrosesan dokumen atau validasi data, kemudian menskalakan setelah menunjukkan perbaikan yang terukur [3].

Gambar 3: Ekosistem agen AI dalam pengembangan perangkat lunak yang menggambarkan integrasi berbagai komponen [Sumber: Index.dev].

Gambar 3: Ekosistem agen AI dalam pengembangan perangkat lunak yang menggambarkan integrasi berbagai komponen [Sumber: Index.dev].

Arsitektur Memori Hierarkis dan Checkpointing

Untuk mengatasi masalah context blindness dan fragmentasi memori, solusi teknis yang menjanjikan adalah pengembangan sistem memori hierarkis yang membedakan antara interaksi jangka pendek, sub-tujuan jangka menengah, dan pengetahuan domain jangka panjang [1]. Dalam implementasinya, ini berarti agen secara berkala menulis progres mereka ke penyimpanan persisten—seperti komentar pada pull request GitHub atau tiket Linear—kemudian memulai ulang dengan konteks segar [9].

Pendekatan ini mengubah cara kita memandang lifecycle agen: dari entitas yang berjalan terus-menerus menjadi serangkaian tugas terbatas yang dapat di-checkpoint dan di-replay. Dalam konteks CI/CD, ini memungkinkan reproducibility yang lebih baik. Jika pipeline gagal pada langkah tertentu, tim dapat menelusuri keputusan agen pada checkpoint terakhir tanpa harus merekonstruksi seluruh rantai kejadian dari awal. Seperti yang ditunjukkan oleh penelitian tentang Retrieval-Augmented Generation (RAG), meskipun solusi ini menawarkan bantuan parsial, mereka masih tidak memadai untuk alur kerja multi-sesi yang kompleks, menunjukkan perlunya arsitektur memori yang lebih canggih [1].

Framework Orkestrasi yang Terstandarisasi

Kemunculan framework seperti Google’s Agent Development Kit (ADK), LangGraph, dan CrewAI menawarkan fondasi untuk mengelola kompleksitas swarm melalui orkestrasi yang terstruktur [5][3]. Framework-framework ini menyediakan kemampuan untuk mendefinisikan alur kerja menggunakan agen-agen orkestrasi—sekuensial, paralel, atau berulang—serta LLM-driven dynamic routing untuk perilaku adaptif [5]. Dalam konteks CI/CD, ini memungkinkan pendefinisian pipeline yang jelas di mana setiap agen memiliki peran, deskripsi kemampuan, dan batasan yang eksplisit.

Namun, pemilihan framework harus dilakukan dengan hati-hati berdasarkan kasus penggunaan spesifik. Sebuah analisis komparatif menunjukkan bahwa CrewAI cocok untuk tim berbasis peran dan prototipe cepat dengan kurva pembelajaran rendah, sementara LangGraph lebih sesuai untuk alur kerja kompleks di industri yang terregulasi [3]. ADK, yang digunakan oleh produk Google seperti Agentspace, menawarkan integrasi yang kuat dengan ekosistem Google Cloud dan kemampuan evaluasi bawaan yang sistematis [5]. Keberhasilan implementasi sangat bergantung pada pemilihan framework yang selaras dengan infrastruktur dan kebutuhan kepatuhan organisasi.

IV. Pro dan Kontra dari Setiap Pendekatan

Gambar 4: Struktur tim pengembangan aplikasi mobile tradisional yang dapat diperkaya dengan agen AI spesialis [Sumber: DDI Development].

Gambar 4: Struktur tim pengembangan aplikasi mobile tradisional yang dapat diperkaya dengan agen AI spesialis [Sumber: DDI Development].

1. Pendekatan Hibrida (Manusia-dalam-Lingkaran)

Keunggulan:

Pendekatan ini menawarkan keseimbangan optimal antara inovasi dan mitigasi risiko. Dengan mempertahankan pengawasan manusia pada titik-titik kritis, organisasi dapat mencegah kesalahan kritis yang mungkin terjadi akibat halusinasi agen. Studi menunjukkan bahwa tim yang mengadopsi alur kerja agentic dengan pengawasan yang baik melaporkan peningkatan moral dan kepemilikan teknis yang lebih kuat, karena pengembang tidak lagi terbebani oleh pekerjaan repetitif yang tidak mendorong bisnis ke depan [8]. Selain itu, pendekatan ini memudahkan kepatuhan terhadap regulasi seperti GDPR yang membatasi keputusan berdasarkan pemrosesan otomatis sepenuhnya [13].

Kelemahan:

Ketergantungan pada pengawasan manusia dapat menciptakan bottleneck baru, terutama dalam tim yang beroperasi dalam zona waktu yang berbeda atau menghadapi tekanan untuk deployment cepat. Jika tidak dikelola dengan baik, autonomy slider dapat menjadi sekadar formalitas, di mana tim kembali ke pola pikir “approve everything” karena ketidakpercayaan pada agen, atau sebaliknya, memberikan otonomi berlebihan karena kelelahan pengawasan. Biaya operasional juga meningkat karena memerlukan tenaga ahli yang mampu memahami dan mengawasi keputusan agen, yang pada dasarnya adalah skill set baru yang harus dikembangkan.

2. Arsitektur Memori Hierarkis

Keunggulan:

Sistem ini secara fundamental mengatasi salah satu keterbatasan teknis terbesar LLM: jendela konteks yang terbatas. Dengan mengimplementasikan checkpointing dan memori persisten, agen dapat menangani tugas-tugas yang memerlukan iterasi panjang tanpa kehilangan jejak tujuan awal. Dalam konteks CI/CD untuk aplikasi mobile dan web yang seringkali melibatkan basis kode besar dan dependensi yang kompleks, kemampuan untuk mempertahankan konteks secara hierarkis sangat berharga. Pendekatan ini juga meningkatkan observability, memungkinkan tim untuk melacak evolusi keputusan agen dari waktu ke waktu [3].

Kelemahan:

Implementasi sistem memori hierarkis menambah kompleksitas arsitektur secara signifikan. Tim harus merancang dan memelihara infrastruktur penyimpanan persisten, protokol serialisasi, dan mekanisme query yang efisien. Overhead ini dapat mengurangi beberapa keuntungan efisiensi yang dijanjikan oleh agentic swarm. Selain itu, jika mekanisme checkpointing tidak dirancang dengan hati-hati, ia dapat memperkenalkan titik kegagalan baru—misalnya, jika agen menulis keadaan yang korup ke memori persisten dan kemudian melanjutkan dari keadaan yang salah tersebut.

3. Framework Orkestrasi Terstandarisasi

Keunggulan:

Penggunaan framework yang mapan seperti ADK atau LangGraph memberikan fondasi yang teruji untuk membangun sistem swarm yang dapat diprediksi. Framework ini menyediakan pola desain yang terbukti, alat evaluasi bawaan, dan komunitas pengembang yang dapat memberikan dukungan. Dalam konteks CI/CD, standarisasi ini sangat penting karena memungkinkan konsistensi dalam bagaimana pipeline didefinisikan dan dieksekusi di berbagai tim dan proyek. Google merekomendasikan penggunaan Agent Starter Pack yang menyediakan pipeline CI/CD siap pakai, manajemen dependensi yang robust, dan dukungan multi-environment [6].

Kelemahan:

Ketergantungan pada framework tertentu dapat menciptakan vendor lock-in atau ketergantungan pada ekosistem spesifik. Jika organisasi memilih ADK, mereka secara de facto terikat pada infrastruktur Google Cloud. Selain itu, framework-framework ini masih dalam tahap evolusi cepat, yang berarti API dan best practices dapat berubah secara signifikan dalam waktu singkat. Tim harus mengalokasikan sumber daya untuk pemeliharaan dan pembaruan berkelanjutan. Lebih fundamental lagi, framework tidak dapat mengatasi keterbatasan inheren dari LLM itu sendiri—mereka hanya menyediakan struktur untuk mengelola kompleksitas, bukan untuk menghilangkan ketidakpastian.

V. Kesimpulan dan Rekomendasi Kondisional

Setelah menelisik berbagai dimensi dari implementasi agentic swarm dalam produksi aplikasi mobile dan web, menjadi jelas bahwa teknologi ini bukanlah peluru ajaib yang dapat diterapkan secara universal, namun juga bukan ancaman yang harus dihindari sepenuhnya. Kebenarannya berada di tengah: agentic swarm dapat menjadi aset yang sangat berharga ketika diterapkan dengan strategi yang tepat, namun dapat berubah menjadi liabilitas besar jika diadopsi secara naif tanpa mempertimbangkan kompleksitas CI/CD.

Untuk organisasi yang mempertimbangkan adopsi, kami merekomendasikan pendekatan kondisional berdasarkan kematangan tim dan karakteristik proyek:

- Pertama, organisasi harus memulai dengan kasus penggunaan terbatas yang berisiko rendah—seperti pembuatan dokumentasi, pemformatan kode, atau pengujian unit—sebelum melangkah ke tugas-tugas yang berdampak langsung pada deployment. Pendekatan “mulai kecil dan skala secara bertahap” telah terbukti menjadi pembeda antara implementasi yang sukses dan eksperimen yang gagal [3].

- Kedua, investasi dalam infrastruktur observability dan governance harus didahulukan sebelum agen pertama kali di-deploy. Ini mencakup logging komprehensif, audit trail untuk setiap keputusan agen, dan mekanisme circuit breaker yang dapat menghentikan swarm secara otomatis jika terdeteksi perilaku anomali [3][8]. Seperti yang dicatat oleh praktisi berpengalaman, “You can’t fix what you can’t see”—tanpa observability, debugging sistem swarm menjadi tugas yang hampir mustahil.

- Ketiga, organisasi harus mempertimbangkan pendekatan hibrida di mana agen spesialis menangani tugas-tugas terisolasi dalam pipeline CI/CD, sementara koordinasi tingkat tinggi tetap dikelola oleh sistem rule-based yang deterministik. Studi tentang koloni semut hibrida yang menggabungkan agen berbasis LLM dengan agen berbasis aturan tradisional menunjukkan tren peningkatan performa dibandingkan kelompok seragam, menunjukkan bahwa kombinasi efisiensi deterministik dan penalaran berbasis teks dapat saling menguntungkan [12].

- Keempat, untuk aplikasi mobile dan web yang menangani data sensitif atau beroperasi di industri yang terregulasi, solusi terbaik saat ini mungkin adalah menunda adopsi agentic swarm untuk tugas-tugas kritis hingga standar keamanan dan kepatuhan yang lebih matang tersedia. Risiko prompt injection, data leakage, dan supply chain drift saat ini masih terlalu tinggi untuk diabaikan [8][13].

Pada akhirnya, agentic swarm adalah alat yang ampuh namun berbahaya—seperti api yang dapat memberikan kehangatan atau menghancurkan, tergantung pada bagaimana kita mengendalikannya. Dekade ini mungkin menjadi “dekade agen” seperti yang diprediksi oleh Andrej Karpathy, namun kesuksesan akan dimiliki oleh organisasi yang mampu menyeimbangkan ambisi otomasi dengan kehati-hatian operasional [7].

Referensi

- [1] S. Liu et al., “AI Agentic Programming: A Survey of Techniques, Challenges, and Opportunities,” arXiv preprint arXiv:2508.11126, 2025. [Online]. Available: https://arxiv.org/html/2508.11126v2

- [2] Esferasoft Solutions, “Multi-Agent AI Systems for Mobile Apps: What They Are & How to Use Them,” Esferasoft Blog, Oct. 2025. [Online]. Available: https://www.esferasoft.com/blog/multi-agent-ai-systems-for-mobile-apps-what-they-are-how-to-use-them

- [3] E. Wexford, “How to Build Multi-Agent Systems: Complete 2026 Guide,” Dev.to, Jan. 2026. [Online]. Available: https://dev.to/eira-wexford/how-to-build-multi-agent-systems-complete-2026-guide-1io6

- [4] Virtuoso QA, “Agentic AI in Continuous Integration: Autonomous Testing & DevOps,” Virtuoso Blog, Aug. 2025. [Online]. Available: https://www.virtuosoqa.com/post/agentic-ai-continuous-integration-autonomous-testing-devops

- [5] Google Developers Blog, “Making it easy to build multi-agent applications,” Google Developers, Apr. 2025. [Online]. Available: https://developers.googleblog.com/en/agent-development-kit-easy-to-build-multi-agent-applications/

- [6] Google Cloud Blog, “Four steps for startups to build multi-agent systems,” Google Cloud, Nov. 2025. [Online]. Available: https://cloud.google.com/blog/topics/startups/four-steps-for-startups-to-build-multi-agent-systems

- [7] Neueon, “When AI Agent Swarms Write Code Faster Than You Can Delete It,” Neueon Insights, Jul. 2025. [Online]. Available: https://www.neueon.com/insights/ai-agent-swarms/

- [8] Checkmarx, “AI Agents and Secure Software Engineering,” Checkmarx Blog, Sep. 2025. [Online]. Available: https://checkmarx.com/blog/ai-agents-and-secure-software-engineering/

- [9] Z. Wills, “I Managed a Swarm of 20 AI Agents for a Week and Built a Product. Here Are the 8 Rules I Learned,” Zach Wills Blog, Aug. 2025. [Online]. Available: https://zachwills.net/i-managed-a-swarm-of-20-ai-agents-for-a-week-here-are-the-8-rules-i-learned/

- [10] A. Lund University, “Evaluation of an AI Assistant Swarm of LLM-based Agents,” LUP Student Papers, 2024. [Online]. Available: https://lup.lub.lu.se/student-papers/record/9188903

- [11] M. Johnson et al., “LLM-Powered Swarms: A New Frontier or a Conceptual Misstep?” arXiv preprint arXiv:2506.14496, Jun. 2025. [Online]. Available: https://arxiv.org/html/2506.14496v1

- [12] S. Johnson et al., “Multi-agent systems powered by large language models,” PMC, 2025. [Online]. Available: https://pmc.ncbi.nlm.nih.gov/articles/PMC12135685/

- [13] Altamira, “Top 5 security risks of autonomous AI agents,” Altamira Blog, Jan. 2026. [Online]. Available: https://www.altamira.ai/blog/5-security-risks-of-autonomous-ai-agents/

- [14] SmythOS, “Challenges in Autonomous Agent Development,” SmythOS Developers, Jan. 2025. [Online]. Available: https://smythos.com/developers/agent-development/challenges-in-autonomous-agent-development/

Comments :