Siapa Pengawas Negeri Ini: Manusia atau Mesin? Menelusuri Masa Depan Tata Kelola Indonesia di Era Kecerdasan Buatan

I. Pendahuluan: Saat Algoritma Mengetuk Pintu Istana

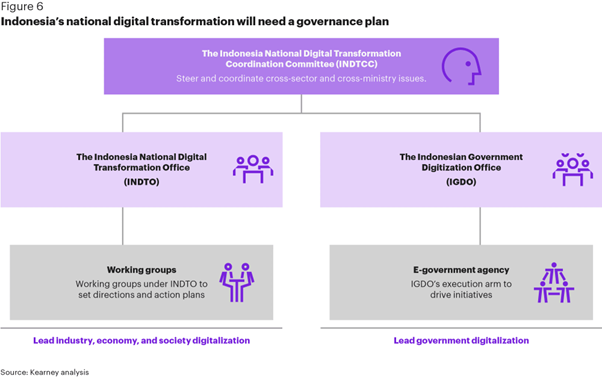

Transformasi Digital Pemerintahan Indonesia – (Sumber: www.kearney.com/7046353163f132f804d8a73f7762e51e8cd7de71)

Transformasi Digital Pemerintahan Indonesia – (Sumber: www.kearney.com/7046353163f132f804d8a73f7762e51e8cd7de71)

Indonesia berdiri di persimpangan sejarah yang menentukan. Negara dengan 17.000 pulau, 280 juta jiwa, dan ekonomi digital terbesar di Asia Tenggara ini menghadapi pertanyaan fundamental yang mengguncang pondasi kenegaraan: “Siapa yang lebih layak mengelola Indonesia—otak manusia yang penuh bias dan korupsi, atau kecerdasan buatan yang dingin namun konsisten?” Pertanyaan ini bukan lagi fiksi ilmiah, melainkan agenda politik yang mendesak. Pada Agustus 2025, Kementerian Komunikasi dan Digital Republik Indonesia menutup konsultasi publik untuk White Paper Peta Jalan Kecerdasan Artifisial Nasional dan Konsep Pedoman Etika Kecerdasan Artifisial, yang dijadwalkan menjadi Peraturan Presiden pada awal 20261. Dokumen-dokumen ini akan menentukan arah Indonesia selama dua dekade mendatang, menjadikan debat tentang AI Governance—tata kelola berbasis kecerdasan buatan—sebagai topik yang tidak bisa ditunda lagi.

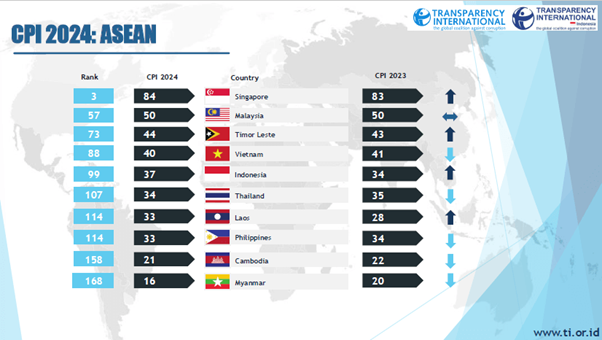

Realitasnya adalah Indonesia saat ini berjuang melawan hantu korupsi yang menggerogoti pilar-pilar demokrasi. Indeks Persepsi Korupsi 2024 dari Transparency International mencatat Indonesia hanya meraih skor 37 dari 100, jauh tertinggal dari Singapura (83), Malaysia (47), dan bahkan Vietnam (40)11. Sementara itu, sektor publik masih dibebani oleh inefisiensi birokrasi yang memakan waktu dan sumber daya. Di sinilah teknologi menawarkan janji manis: algoritma yang tidak kenal lelah, tidak bisa disuap, dan mampu memproses data dalam skala massal yang mustahil dijangkau aparatur manusia. Namun, janji ini datang dengan risiko yang sama besarnya—diskriminasi tersembunyi, hilangnya akuntabilitas, dan delegasi kekuasaan kepada entitas yang tidak memiliki nurani. Artikel ini menelusuri lima dimensi krusial dalam perdebatan ini, dari fondasi hukum hingga alternatif masa depan, untuk menjawab pertanyaan esensial: bagaimana Indonesia harus menyusun kembali arsitektur kekuasaan negara di era digital?

II. Fondasi Hukum: Menyusun Aturan Main di Tanah Air yang Belum Mapan

Lanskap regulasi kecerdasan buatan di Indonesia masih berada dalam fase transisi yang rapuh. Hingga akhir 2025, Indonesia tidak memiliki undang-undang khusus yang mengatur AI. Yang ada hanyalah Surat Edaran Kementerian Komunikasi dan Informatika Nomor 9 Tahun 2023 tentang Pedoman Etika Kecerdasan Artifisial, yang bersifat non-binding atau tidak mengikat secara hukum. Dokumen ini menetapkan sembilan prinsip etika—inklusivitas, kemanusiaan, keamanan, aksesibilitas, transparansi, kredibilitas dan akuntabilitas, perlindungan data pribadi, pembangunan berkelanjutan, serta hak kekayaan intelektual—namun tidak disertai mekanisme sanksi atau kepatuhan yang konkret2.

Namun dinamika berubah cepat. Pemerintah Indonesia berencana menerbitkan dua Peraturan Presiden pada awal 2026: satu tentang Peta Jalan AI Nasional dan satu lagi tentang Etika dan Keselamatan AI7. Rancangan regulasi ini dikembangkan oleh AI Roadmap Task Force yang terdiri dari 443 anggota mewakili pemerintah, akademisi, industri, dan masyarakat sipil5. Berbeda dengan Surat Edaran 2023, Peraturan Presiden akan memiliki kekuatan hukum yang mengikat, meskipun masih mempertahankan pendekatan self-assessment di mana pengembang AI diminta mengevaluasi diri sendiri terhadap kepatuhan etika3.

Jakarta Smart City Command Center (Sumber: https://smartcity.jakarta.go.id/d4381fd033ce6c484a9eef1955bcca02966a44e9.jpg)

Jakarta Smart City Command Center (Sumber: https://smartcity.jakarta.go.id/d4381fd033ce6c484a9eef1955bcca02966a44e9.jpg)

Dalam konteks regional, Indonesia mengikuti jejak negara-negara Asia Tenggara lainnya. ASEAN telah menerbitkan Guide on AI Governance and Ethics pada Februari 2024 yang menekankan tujuh prinsip—transparansi, keadilan, keamanan, keandalan, human-sentris, privasi, dan akuntabilitas—namun bersifat sukarela tanpa mekanisme penegakan12. Singapura, yang memimpin dalam tata kelola digital regional, telah mengimplementasikan Model AI Governance Framework dan toolkit AI Verify yang lebih operasional12. Sementara itu, Uni Eropa dengan AI Act-nya menerapkan pendekatan berbasis risiko yang lebih keras, mengklasifikasikan sistem AI dalam kategori risiko rendah, sedang, dan tinggi dengan persyaratan ketat untuk aplikasi berisiko tinggi seperti penilaian kredit dan sistem pengawasan10.

Tantangan spesifik Indonesia terletak pada kompleksitas tata kelola desentralisasi. Dengan 34 provinsi dan ratusan kabupaten/kota, implementasi regulasi nasional seringkali menghadapi hambatan di tingkat lokal8. Selain itu, UU Perlindungan Data Pribadi Nomor 27 Tahun 2022 yang mulai berlaku penuh sejak Oktober 2024 memberikan fondasi penting, namun implementasinya masih menghadapi tantangan terkait infrastruktur dan kesadaran hukum8. Pasal 25 UU PDP memberikan hak kepada individu untuk menolak keputusan yang sepenuhnya otomatis dengan dampak hukum atau signifikan, yang secara tidak langsung membatasi penggunaan AI dalam pengambilan keputusan administratif tanpa campur tangan manusia4.

III. Diagnosis Krisis: Korupsi dan Inefisiensi yang Menghantui Birokrasi

Untuk memahami mengapa AI terlihat seperti solusi yang menarik, kita harus menghadapi realitas pahit tentang kondisi tata kelola Indonesia saat ini. Korupsi bukan lagi sekadar masalah individu, melainkan sistemik dan telah menjadi budaya yang mengakar. Skor 37 dalam Indeks Persepsi Korupsi 2024 menempatkan Indonesia di peringkat 99 dari 180 negara, di bawah rata-rata global 43 dan rata-rata Asia Pasifik 4411. Yang lebih memprihatinkan, peningkatan tiga poin dari skor 34 pada tahun 2023 sebagian besar disebabkan oleh perubahan metodologi pengukuran, bukan oleh perubahan substansial dalam pemberantasan korupsi14.

Indeks Persepsi Korupsi Indonesia (Sumber: https://www.transparency.org/en/press/transparency-international-indonesia-crackdown-on-protest-is-dangerous-erosion-of-civic-space)

Indeks Persepsi Korupsi Indonesia (Sumber: https://www.transparency.org/en/press/transparency-international-indonesia-crackdown-on-protest-is-dangerous-erosion-of-civic-space)

Dr. Rimawan Pradiptyo dari Fakultas Ekonomika dan Bisnis Universitas Gadjah Mada mengidentifikasi tiga faktor krusial yang menghambat pemberantasan korupsi: lemahnya reformasi institusional, menurunnya independensi lembaga penegak hukum, serta budaya korupsi yang telah mengakar dalam14. Kasus-kasus seperti Rempang Eco City yang dituduh mengabaikan transparansi dan melibatkan konflik kepentingan para pejabat, serta kasus suap pembangunan pembangkit listrik tenaga batu bara yang menjerat politikus dari partai besar, menggambarkan bagaimana korupsi merusak sektor energi dan pembangunan11.

Namun korupsi hanya satu sisi masalah. Inefisiensi birokrasi yang menghambat investasi dan inovasi sama merusaknya. World Bank mencatat bahwa perusahaan di Indonesia sering menghadapi red tape yang berbelit dan praktik pungutan liar dalam proses perizinan. Survei menunjukkan bahwa hampir separuh aparatur sipil negara mengakui telah menerima suap dalam bentuk apa pun. Sistem peradilan yang lemah, dengan Mahkamah Agung mendapat peringkat terendah dalam integritas sektor publik pada Survei Integritas Sektor Publik 2008, menambah kompleksitas masalah21.

Di tengah kondisi ini, kecerdasan buatan menawarkan narasi penebusan yang kuat. Bayangkan sistem perizinan online yang sepenuhnya otomatis, di mana tidak ada ruang untuk “biaya koordinasi” atau “uang rokok”. Bayangkan algoritma yang menganalisis pola pengeluaran pemerintah dan mendeteksi anomali secara real-time, jauh sebelum auditor manusia menyadari adanya kecurangan. Kemajuan dalam e-government menunjukkan potensi ini: Indonesia melonjak 13 peringkat dalam Survei Pemerintah Elektronik PBB 2024, dari peringkat 77 menjadi 64 dari 193 negara, dan beralih dari kategori EGDI tinggi menjadi sangat tinggi15. Bahkan dalam Waseda University World Digital Government Rankings 2025, Indonesia berada di peringkat 23 dengan skor 76,82, mengungguli India dan Spanyol16.

Namun optimisme teknologis ini perlu diimbangi dengan kewaspadaan. Sejarah menunjukkan bahwa teknologi seringkali memperkuat ketimpangan yang sudah ada daripada menghapuskannya. Tanpa kerangka regulasi yang kuat, AI bisa menjadi alat baru untuk korupsi yang lebih canggih—misalnya, manipulasi algoritma untuk menguntungkan kontraktor tertentu dalam proses pengadaan barang dan jasa.

IV. Uji Coba Teknologi: Antara Janji Efisiensi dan Jebakan Algoritmik

Implementasi AI dalam pemerintahan bukan lagi sekadar wacana akademik. Berbagai negara telah melakukan uji coba yang memberikan pelajaran berharga—baik yang menjanjikan maupun yang mengkhawatirkan. Di Indonesia sendiri, aplikasi JAKI (Jakarta Kini) dan berbagai inisiatif Jakarta Smart City menunjukkan bagaimana data dan algoritma mulai digunakan untuk manajemen lalu lintas, pengelolaan banjir, dan pelayanan publik2. Peta Jalan AI Nasional yang sedang disusun merencanakan “quick wins” seperti penerapan AI untuk prakiraan cuaca pertanian dan rekomendasi medis awal berdasarkan data pemeriksaan kesehatan5.

Etika AI dalam Tata Kelola (Sumber: https://thumbs.dreamstime.com/230ee25593b5e8f049b5b2ff505484e8159d432e.jpg)

Etika AI dalam Tata Kelola (Sumber: https://thumbs.dreamstime.com/230ee25593b5e8f049b5b2ff505484e8159d432e.jpg)

Namun pengalaman global memberikan peringatan keras tentang risiko algorithmic bias—prasangka algoritmik yang dapat mendiskriminasi kelompok masyarakat tertentu. Kasus paling terkenal terjadi di Belanda pada 2019, ketika otoritas pajak menggunakan algoritma self-learning untuk membuat profil risiko terkait dugaan penipuan tunjangan anak. Sistem ini secara tidak proporsional menargetkan keluarga berpenghasilan rendah dan kelompok etnis minoritas dengan kewarganegaraan ganda. Akibatnya, puluhan ribu keluarga terpaksa mengembalikan tunjangan yang telah diterima, menimbulkan kemiskinan, dan lebih dari seribu anak harus dipindahkan ke panti asuhan. Otoritas Perlindungan Data Belanda kemudian menyimpulkan bahwa pengolahan data oleh sistem tersebut bersifat diskriminatif17.

Di Amerika Serikat, algoritma COMPAS yang digunakan untuk menilai risiko residivis dalam sistem peradilan pidana menunjukkan bias rasial yang mengkhawatirkan. Analisis ProPublica pada 2016 menemukan bahwa algoritma ini dua kali lebih mungkin secara keliru melabel terdakwa kulit hitam sebagai kriminal masa depan dibanding terdakwa kulit putih, sementara terdakwa kulit putih lebih sering secara keliru dilabel sebagai risiko rendah padahal kemudian melakukan kejahatan20. Algoritma PredPol untuk prediktif policing di Oakland, California, secara tidak sengaja menargetkan lingkungan kulit hitam dua kali lebih sering dibanding lingkungan kulit putih karena dilatih dengan data penangkapan yang sudah bias secara rasial18.

Di sektor ketenagakerjaan, algoritma rekrutmen juga menunjukkan bias gender dan usia. Perusahaan iTutorGroup pada 2023 setuju membayar $365.000 untuk menyelesaikan tuntutan hukum setelah perangkat lunak rekrutmen mereka diprogram untuk secara otomatis menolak pelamar wanita di atas 55 tahun dan pelamar pria di atas 60 tahun19. Di Indonesia, penggunaan AI dalam penyaringan CV dan seleksi awal kandidat sudah mulai marak, namun belum ada regulasi spesifik yang melindungi hak pelamar terhadap diskriminasi algoritmik4.

Yang membuat masalah ini lebih kompleks adalah sifat black box dari banyak sistem AI—keputusan diambil tanpa transparansi tentang bagaimana kesimpulan tersebut dihasilkan. Ketika warga negara Indonesia ditolak akses layanan publik atau kehilangan bantuan sosial karena keputusan algoritma, siapa yang bertanggung jawab? Bagaimana mereka bisa mengajukan banding terhadap keputusan yang bahkan tidak mereka mengerti logikanya? Ini bukan spekulasi futuristik, melainkan realitas yang sudah terjadi di berbagai negara dan bisa terulang di Indonesia jika tata kelola AI tidak dirancang dengan hati-hati.

V. Dilema Moral: Kecepatan versus Akuntabilitas dalam Pengambilan Keputusan

Inti dari perdebatan AI Governance adalah pertanyaan tentang legitimasi kekuasaan. Dalam sistem demokrasi, kekuasaan negara berasal dari persetujuan rakyat yang diwakili oleh pejabat yang dapat dimintai pertanggungjawaban melalui proses pemilihan. Ketika keputusan dialihkan dari manusia ke mesin, rantai akuntabilitas ini menjadi kabur. Siapa yang harus disalahkan ketika AI membuat keputusan yang merugikan: programmer yang menulis kode, data scientist yang melatih model, pejabat yang mengimplementasikan sistem, atau mesin itu sendiri?

Indonesia menghadapi dilema khusus karena fondasi filosofis negara—Pancasila—menekankan nilai-nilai kemanusiaan dan keadilan sosial. Pedoman Etika AI yang dikeluarkan Otoritas Jasa Keuangan (OJK) pada 2023 secara eksplisit mensyaratkan bahwa penggunaan AI harus berlandaskan Pancasila, memberikan manfaat nyata, adil dan dapat dipertanggungjawabkan, transparan dan dapat dijelaskan, serta kuat dan aman secara keamanan siber10. Ini berarti AI di Indonesia tidak bisa diadopsi secara mentah dari model Barat, melainkan harus disesuaikan dengan konteks sosial dan budaya lokal.

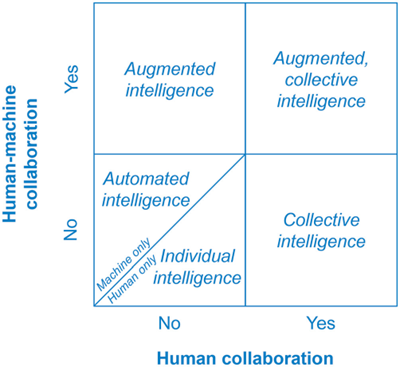

Kolaborasi Manusia dan AI (Sumber: https://journals.sagepub.com/f104f3de69b2340b68806c2dff65ef96a2aa7fd5.jpg)

Kolaborasi Manusia dan AI (Sumber: https://journals.sagepub.com/f104f3de69b2340b68806c2dff65ef96a2aa7fd5.jpg)

Namun tekanan untuk beralih ke otomasi sangat kuat. Dengan kebutuhan 9 juta pekerja teknologi tambahan hingga 2030 dan target transformasi digital yang ambisius, pemerintah Indonesia berada dalam situasi catch-221. Di satu sisi, AI bisa mengatasi kekurangan talenta digital dengan mengotomatisasi tugas-tugas rutin. Di sisi lain, implementasi yang terburu-buru tanpa infrastruktur hukum yang memadai bisa menciptakan krisis legitimasi yang lebih dalam daripada korupsi yang sekarang diperangi.

Ada tiga model utama dalam kolaborasi manusia-AI yang bisa dipertimbangkan. Model pertama adalah Human-in-the-loop, di mana AI memberikan rekomendasi namun keputusan final tetap di tangan manusia. Ini menjaga akuntabilitas namun memperlambat proses. Model kedua adalah Human-on-the-loop, di mana AI beroperasi secara otonom namun manusia memiliki kemampuan untuk mengintervensi jika terjadi anomali. Model ketiga adalah Human-out-of-the-loop, otomasi penuh yang paling efisien namun paling berisiko dalam hal akuntabilitas17. Peta Jalan AI Nasional Indonesia tampaknya condong ke model human-on-the-loop, yang sejalan dengan prinsip OJK tentang pendekatan “human-on-the-loop” untuk memastikan pengendalian proses AI10.

Namun implementasi nyata lebih rumit. Dalam praktik, manusia yang seharusnya mengawasi AI seringkali tidak memiliki pemahaman teknis yang cukup untuk menilai apakah rekomendasi AI sudah benar. Fenomena ini disebut automation bias, di mana manusia cenderung mempercayai keputusan mesin bahkan ketika ada bukti kontradiktor. Dalam konteks pemerintahan Indonesia, di mana kapasitas teknis masih terbatas di banyak daerah, risiko ini menjadi sangat nyata.

VI. Masa Depan Hybrid: Menuju Tata Kelola Augmented Intelligence

Setelah menelusuri berbagai dimensi masalah ini, jawaban atas pertanyaan “AI atau manusia?” bukanlah pilihan biner. Solusi terbaik untuk Indonesia adalah pendekatan augmented intelligence—manusia dan AI bekerja bersama, masing-masing mengisi kekurangan yang lain. Manusia unggul dalam penilaian etis, empati, dan pemahaman konteks sosial yang kompleks. AI unggul dalam pemrosesan data skala besar, konsistensi, dan deteksi pola yang tidak terlihat oleh mata manusia.

Untuk mewujudkan visi ini, Indonesia perlu menerapkan strategi kondisional yang dibagi dalam tiga zona. Zona Pertama adalah otomasi penuh untuk tugas-tugas administratif rutin yang berulang dan berbasis aturan yang jelas—seperti pemrosesan izin mendirikan bangunan yang memenuhi standar teknis, pembayaran pajak, atau verifikasi data kependudukan sederhana. Di zona ini, risiko diskriminasi rendah dan efisiensi menjadi prioritas utama.

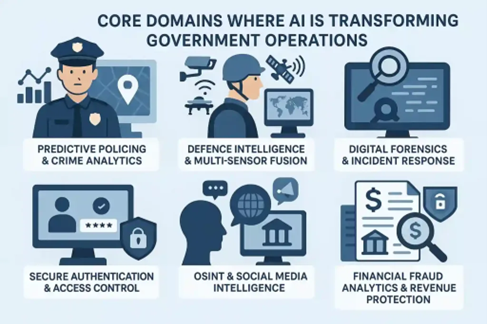

AI untuk Pemerintahan Modern (Sumber: https://innefu.com/94231a30b8c0ff745fefde3f89d799468ef523c0.webp)

AI untuk Pemerintahan Modern (Sumber: https://innefu.com/94231a30b8c0ff745fefde3f89d799468ef523c0.webp)

Zona Kedua adalah kolaborasi manusia-AI untuk keputusan yang memerlukan pertimbangan kompleks namun data-driven—seperti alokasi anggaran pembangunan, penilaian kelayakan kredit UMKM, atau penanganan kasus pengaduan masyarakat. AI menganalisis data dan memberikan rekomendasi, namun pejabat publik membuat keputusan final dengan pertimbangan kontekstual. Zona ini memerlukan transparansi algoritma dan hak banding bagi warga.

Zona Ketiga adalah penentuan manusia murni untuk keputusan yang bersifat fundamental hak asasi manusia—seperti penentuan status kewarganegaraan, keputusan hukum pidana, kebijakan sosial yang memengaruhi kelompok rentan, atau keputusan terkait kebebasan berbicara. Di zona ini, AI tidak boleh memiliki kewenangan pengambilan keputusan, meskipun bisa digunakan sebagai alat riset.

Untuk mendukung kerangka ini, Indonesia perlu membangun infrastruktur tata kelola yang terdiri dari lima pilar. Pertama, pembentukan Badan Nasional Kecerdasan Artifisial yang independen dan multidisiplin, sebagaimana direkomendasikan UNESCO1, untuk mengkoordinasikan kebijakan lintas sektor. Kedua, penerapan regulatory sandbox yang memungkinkan pengujian AI dalam lingkungan terkontrol sebelum implementasi massal1. Ketiga, kewajiban transparansi algoritma bagi sistem AI yang digunakan dalam sektor publik, termasuk hak warga untuk penjelasan atas keputusan yang memengaruhi mereka. Keempat, investasi besar-besaran dalam literasi AI untuk aparatur sipil dan masyarakat umum, mengingat 66,5% penetrasi internet di Indonesia masih belum merata1. Kelima, mekanisme audit etika AI yang rutin melibatkan masyarakat sipil, bukan hanya pemerintah dan industri.

Pro dan kontra dari pendekatan hybrid ini perlu dipertimbangkan secara jujur. Sisi positifnya adalah keseimbangan antara efisiensi dan akuntabilitas, adaptasi terhadap konteks lokal Indonesia, serta fleksibilitas untuk berevolusi seiring kemajuan teknologi. Risikonya adalah kompleksitas implementasi yang tinggi, potensi celah hukum di zona transisi, dan kebutuhan sumber daya yang besar untuk melatih pejabat yang mampu mengawasi AI. Namun dibandingkan dengan risiko otomasi buta atau stagnasi birokratik, pendekatan hybrid menawarkan jalur tengah yang paling realistis.

VII. Kesimpulan: Kembali ke Esensi Kemanusiaan

Setelah perjalanan panjang menelusuri dimensi hukum, sosial, teknologis, dan etis dari AI Governance, kesimpulannya adalah bahwa Indonesia tidak boleh dan tidak bisa menyerahkan pemerintahannya sepenuhnya kepada algoritma. Namun begitu pula, Indonesia tidak bisa mempertahankan status quo birokrasi yang korup dan tidak efisien. Jalan tengah adalah augmented governance—tata kelola yang diperkaya oleh AI namun tetap dipegang teguh oleh tangan manusia yang bertanggung jawab.

Prinsip fundamental yang harus dipegang adalah bahwa AI adalah alat, bukan penguasa. Sebagaimana palu dan gergaji membantu tukang bangunan namun tidak menggantikan keahliannya, AI harus membantu aparatur negara melayani rakyat dengan lebih baik, bukan menggantikan keputusan-keputusan yang bersifat kemanusiaan. Hal ini sejalan dengan nilai-nilai Pancasila yang menjadi dasar negara, terutama sila kedua tentang kemanusiaan yang adil dan beradab.

Indonesia berada dalam posisi unik untuk belajar dari kesalahan negara-negara maju yang terburu-buru mengadopsi AI tanpa perlindungan yang memadai, sambil memanfaatkan kemajuan teknologi untuk melompat menghindari jebakan birokrasi tradisional. Peta Jalan AI Nasional 2020-2045 yang sedang disempurnakan menawarkan kesempatan emas untuk membangun fondasi yang kokoh9. Namun keberhasilan bergantung pada keberanian pemerintah untuk mengutamakan perlindungan warga daripada efisiensi semata, melibatkan masyarakat sipil dalam pengawasan, dan berinvestasi dalam kapasitas sumber daya manusia.

Pertanyaan “AI atau manusia?” pada akhirnya terjawab dengan “Manusia yang didukung AI, untuk kemanusiaan yang lebih baik.” Indonesia tidak memerlukan robot sebagai pegawai negeri, melainkan pegawai negeri yang cukup cerdas untuk menggunakan robot dengan bijak. Dalam konteks Indonesia yang plural dan kompleks, teknologi harus menjadi jembatan menuju keadilan sosial, bukan pemisah yang memperdalam ketimpangan. Masa depan tata kelola Indonesia—seperti halnya masa depan demokrasi global—bergantung pada kemampuan kita untuk mengingat bahwa di balik setiap data point, setiap algoritma, dan setiap kebijakan, ada manusia yang pantas dihormati dan dilindungi.

Referensi

- UNESCO. “Indonesia | Global AI Ethics and Governance Observatory.” UNESCO, 2026. https://www.unesco.org/ethics-ai/en/indonesia. (Diakses: 5 Februari 2026).

- Lexology. “AI Laws and Guidelines Around the World – Part 1: Indonesia.” Lexology, 13 November 2025. https://www.lexology.com/library/detail.aspx?g=8aa2bef7-454c-414e-9ddf-a697cb5687b1.

- Weekly Aiving. “Indonesia Advances Presidential Regulation for AI Ethics Guidelines.” Weekly Aiving, 9 September 2025. https://weeklyaiving.com/en/indonesia-advances-presidential-regulation-for-ai-ethics-guidelines/.

- ABNR Law. “Legal 500 Country Comparative Guides 2025: Indonesia.” ABNR Law, 12 Agustus 2025. https://www.abnrlaw.com/files/document/mpdf_AI1.pdf.

- BRICS Competition Law and Policy Centre. “Indonesia Publishes AI Roadmap, Ethics Framework.” BRICS Competition Centre, 11 Agustus 2025. https://www.bricscompetition.org/news/indonesia-publishes-ai-roadmap-ethics-framework.

- BABL AI. “Indonesia Launches Public Consultation on National AI Roadmap and Ethics Guidelines.” BABL AI, 12 Agustus 2025 (Update November 2025). https://babl.ai/indonesia-launches-public-consultation-on-national-ai-roadmap-and-ethics-guidelines/.

- Tech in Asia. “Indonesia to Roll Out National AI Rules in Early 2026.” Tech in Asia, 17 Desember 2025. https://www.techinasia.com/news/indonesia-to-roll-out-national-ai-rules-in-early-2026.

- U.S. Department of Commerce. “Indonesia Digital Economy.” International Trade Administration, 17 November 2025. https://www.trade.gov/country-commercial-guides/indonesia-digital-economy.

- Herbert Smith Freehills Kramer. “AI Tracker Indonesia.” HSF Kramer, 10 Desember 2025. https://www.hsfkramer.com/insights/reports/ai-tracker/indonesia.

- Herbert Smith Freehills Kramer. “Ethical Guidelines on Use of Artificial Intelligence (AI) in Indonesia.” HSF Kramer, 12 Februari 2024. https://www.hsfkramer.com/notes/tmt/2024-02/ethical-guidelines-on-use-of-artificial-intelligence-ai-in-indonesia.

- Transparency International. “Indonesia Crackdown on Protest is Dangerous Erosion of Civic Space.” Transparency International, 2 September 2025. https://www.transparency.org/en/press/transparency-international-indonesia-crackdown-on-protest-is-dangerous-erosion-of-civic-space.

- CSIS. “Beyond the Matrix: AI Governance Gaps in Southeast Asia.” Center for Strategic and International Studies, 26 Agustus 2025. https://www.csis.org/blogs/new-perspectives-asia/beyond-matrix-ai-governance-gaps-southeast-asia.

- Transparency International. “2024 Corruption Perceptions Index: Countries on Front Line of Climate Crisis in Asia Pacific Struggling to Fight Back Corruption.” Transparency International, 11 Februari 2025. https://www.transparency.org/en/press/2024-corruption-perceptions-index-countries-on-front-line-of-climate-crisis-in-asia-pacific-struggling-to-fight-back-corruption.

- Universitas Gadjah Mada. “Indonesia’s Corruption Perception Index Remains Low, UGM Expert Cites Weak Institutional Reform and Deep-Rooted Corruption Culture.” UGM, 17 Februari 2025. https://ugm.ac.id/en/news/indonesias-corruption-perception-index-remains-low-ugm-expert-cites-weak-institutional-reform-and-deep-rooted-corruption-culture/.

- GovInsider. “Indonesia’s Global E-Government Ranking Jumped 13 Places.” GovInsider, 19 September 2024. https://govinsider.asia/intl-en/article/indonesias-global-e-government-ranking-jumped-13-places.

- Waseda University. “The 20th World Digital Government Rankings 2025.” Institute of Digital Government, Waseda University, 1 November 2025. https://idg-waseda.jp/pdf/2025_Digital_Government_Ranking_Report.pdf.

- AlgorithmWatch. “How and Why Algorithms Discriminate.” AlgorithmWatch, 26 Juni 2024. https://algorithmwatch.org/en/how-and-why-algorithms-discriminate/.

- Greenlining Institute. “Algorithmic Bias Explained.” Greenlining Institute, 2021. https://greenlining.org/wp-content/uploads/2021/04/Greenlining-Institute-Algorithmic-Bias-Explained-Report-Feb-2021.pdf.

- EWSolutions. “Algorithmic Discrimination: A CDO’s Guide to AI Governance.” Enterprise Warehousing Solutions, 26 Januari 2026. https://www.ewsolutions.com/algorithmic-discrimination/.

- Harvard Kennedy School Data-Smart City Solutions. “Algorithmic Fairness: Tackling Bias in City Algorithms.” Data-Smart City Solutions, 31 Agustus 2018. https://datasmart.hks.harvard.edu/news/article/algorithmic-fairness-tackling-bias-city-algorithms.

- “The ABCs of the CPI: How the Corruption Perceptions Index is calculated”. Transparency.org. 11 February 2025. Retrieved 6 March 2025. https://www.transparency.org/en/news/how-cpi-scores-are-calculated

Comments :