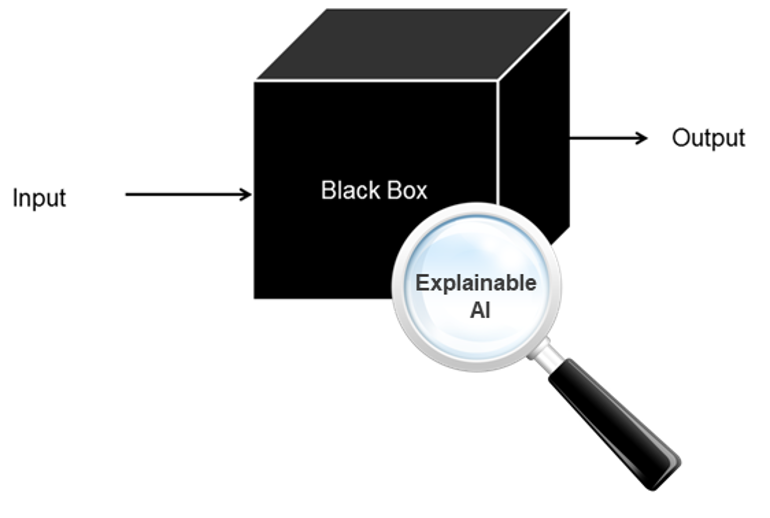

Mengapa Keputusan AI Tak Boleh Jadi “Kotak Hitam”? Mengenal Explainable AI (XAI)

Di era digital, kecerdasan buatan (AI) telah menjadi pendorong utama di berbagai sektor, mulai dari diagnosis medis hingga penilaian kelayakan kredit. Namun, seiring dengan semakin canggihnya model, muncul tantangan krusial: mengapa AI membuat keputusan tertentu? Seringkali, model AI kompleks seperti deep learning beroperasi seperti “kotak hitam”; mereka memberikan hasil yang akurat, tetapi tanpa penjelasan yang transparan. Inilah mengapa konsep Explainable AI (XAI) hadir, bertujuan untuk membuka kotak hitam tersebut dan membangun kepercayaan manusia terhadap mesin. Artikel ini akan membahas XAI, manfaatnya, serta penerapannya yang penting di berbagai industri.

Source: https://adamfard.com/blog/explainable-ai

XAI: Kunci Transparansi dan Kepercayaan dalam AI

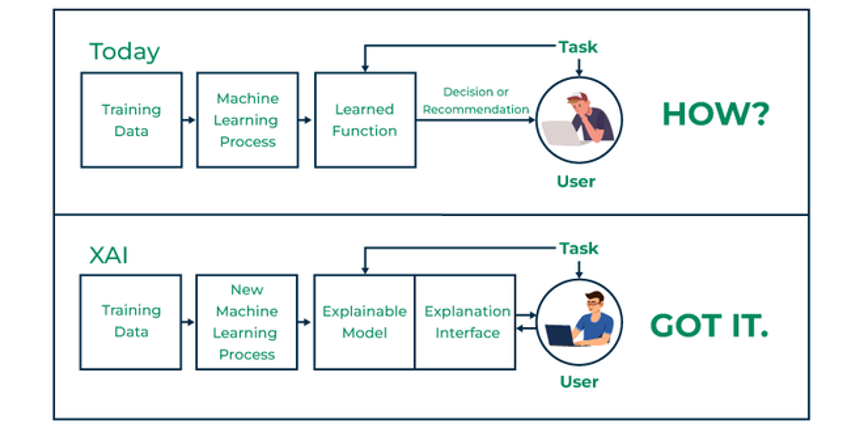

Explainable AI (XAI) adalah sebuah bidang dalam kecerdasan buatan yang berfokus untuk membuat perilaku, hasil, dan prediksi dari sistem AI dapat dipahami oleh manusia. XAI mengubah model yang sebelumnya buram menjadi model yang “transparan” atau “kotak kaca.”

Bayangkan AI sebagai seorang koki andal. Tanpa XAI, ia hanya menyajikan hidangan lezat (hasil prediksi), tetapi tidak memberikan resepnya. Dengan XAI, koki tersebut menjelaskan, “Saya memprediksi harga saham naik karena data sentimen pasar sangat positif dan volume perdagangan meningkat,” memberikan alasan yang jelas (kontribusi fitur) di balik keputusannya.

Tujuan utama XAI adalah memastikan bahwa sistem AI tidak hanya akurat, tetapi juga dapat dipertanggungjawabkan (accountable), adil (fair), dan dapat dipercaya (trustworthy).

Manfaat Utama Explainable AI

Source: https://www.geeksforgeeks.org/artificial-intelligence/explainable-artificial-intelligencexai/

Penerapan XAI memberikan banyak keuntungan, terutama di sektor berisiko tinggi:

- Membangun Kepercayaan: Pengguna, mulai dari dokter hingga regulator, akan lebih percaya pada sistem yang dapat menjelaskan mengapa suatu keputusan diambil. Ini krusial untuk adopsi AI secara luas.

- Debug dan Optimalisasi Model: Penjelasan XAI (sering disebut Feature Attribution) membantu pengembang mengidentifikasi dan memperbaiki bias atau kesalahan yang tidak terduga dalam data pelatihan, yang dapat menyebabkan hasil yang diskriminatif atau tidak logis.

- Kepatuhan Regulasi: Di banyak wilayah, terutama sektor keuangan dan kesehatan, regulasi menuntut kemampuan untuk menjelaskan dan mengaudit keputusan otomatis. XAI memfasilitasi kepatuhan ini.

- Pengetahuan yang Lebih Dalam: XAI membantu peneliti dan pengguna mendapatkan wawasan baru (insight) tentang hubungan antarvariabel dalam data, yang mungkin terlewatkan tanpa penjelasan model.

Metode Utama dalam XAI

Secara umum, interpretasi model dapat dikelompokkan menjadi dua jenis:

- Interpretasi Global (Global Explainability): Menjelaskan bagaimana model bekerja secara keseluruhan (misalnya, fitur apa yang paling penting secara umum).

- Interpretasi Lokal (Local Explainability): Menjelaskan mengapa model membuat prediksi tunggal (misalnya, mengapa pinjaman ini disetujui).

Metode yang populer untuk mencapai XAI, terutama untuk model kompleks (model-agnostic), termasuk LIME (Local Interpretable Model-agnostic Explanations) dan SHAP (SHapley Additive exPlanations). Metode ini memberikan skor atribusi yang menunjukkan seberapa besar pengaruh setiap fitur input terhadap hasil prediksi.

Penerapan XAI di Berbagai Industri

XAI telah menjadi kebutuhan mendasar dalam penerapan AI di sektor kritis:

- Layanan Kesehatan: Dalam diagnosis medis, XAI memungkinkan dokter untuk melihat fitur-fitur pada gambar medis (seperti CT scan) atau data pasien yang paling memengaruhi keputusan AI. Hal ini meningkatkan kepercayaan dokter dan pasien serta mengurangi risiko kesalahan fatal.

- Layanan Keuangan: Dalam penilaian kelayakan kredit, XAI menjelaskan kepada nasabah dan regulator faktor-faktor apa saja (misalnya riwayat pembayaran, skor kredit) yang menyebabkan permohonan kredit disetujui atau ditolak, memastikan proses yang adil dan non-diskriminatif.

- Hukum dan Pemerintahan: XAI digunakan untuk memastikan bahwa keputusan otomatis yang memengaruhi kebebasan atau hak warga negara (seperti dalam sistem peradilan prediktif) dapat dipertanggungjawabkan dan tidak mengandung bias.

Kesimpulan

Explainable AI (XAI) adalah jembatan yang menghubungkan akurasi AI dengan kebutuhan manusia akan pemahaman dan kepercayaan. Dengan membuat proses keputusan AI transparan—tidak lagi menjadi “kotak hitam”—XAI tidak hanya membantu kita melakukan debugging dan mengoptimalkan model, tetapi juga memastikan bahwa sistem AI dapat dipertanggungjawabkan dan beroperasi secara etis dan adil. Dalam perkembangan AI ke depan, XAI akan menjadi pilar utama yang menentukan keberhasilan adopsi AI skala besar.

Penulis: Dr. Prabowo Wahyu Sudarno, S.Kom.

Referensi Artikel

- IBM. Apa yang dimaksud dengan Explainable AI (XAI)?.

- Google Cloud. Pengantar Vertex Explainable AI.

- Ribeiro, M. T., Singh, S., & Guestrin, C. (2016). “Why Should I Trust You?” Explaining the Predictions of Any Classifier. Proceedings of the 22nd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining.

- https://adamfard.com/blog/explainable-ai

- https://www.geeksforgeeks.org/artificial-intelligence/explainable-artificial-intelligencexai/

Comments :